3 月 26 日晚,vivo 发布了一揽子新品,包括「折叠屏」X Fold3/Fold3 Pro、「平板」Pad3 Pro 等等,雷科技已进行全程报道,且提前对X Fold3 Pro这款重量级折叠屏旗舰进行了深度评测(具体可到雷科技微信(ID:leitech)查看)。

其实在这么多新品中,有一款不起眼却很重要的「小」产品十分值得讨论,那就是:

2016 年至今,TWS 真无线耳机已经完全成长为耳机市场最重要的一种品类。而这个还在继续增长的市场中,vivo 这几年的「卷」能算得上是很突出,特别是在同价位的降噪和延迟表现上。

到了最新一代的 vivo TWS 4,除了降噪深度上的进一步提升,vivo 还用上了过去在万元级高端音响上的陶瓷钨振膜单元,将高音的截止频率提高到 48kHz,除了提高高频细节的表现,据称还解决了高音分割振动带来的失真问题。

在这款芯片的支持下,vivo TWS 4 HiFI 版能轻松实现最高 1.2Mbps 的传输码率,相当接近 CD 无损音频所需要的 1.4Mbps 传输码率标准。

不仅如此,一起发布的第三代高通 S5 音频芯片更是基于高通 S7 标准架构,AI 性能比前代暴涨了 50 多倍。

考虑到今天计算音频早已成为耳机行业的共识,AI 驱动的趋势也慢慢的变明显,高通最新发布的两款芯片,显然无法小觑。

计算音频不是一个新鲜的话题。尤其是从苹果在 WWDC20 上宣布「空间音频」开始,计算音频时不时就会成为行业、媒体关注的焦点。

无线耳机,尤其是 TWS 真无线耳机从一开始就确立要抛弃音质,换来便携性和更方便的使用体验,并随后开始席卷全球市场,成为时代新宠。但这并不意味着音质不重要,在解决过去有线耳机「使用不便」的问题后,过去几年 TWS 耳机最主要的迭代方向实际上的意思就是两点:

但受限于体积和无线形态,TWS 耳机的音频元器件性能天生孱弱,就像智能手机同样受限于体积等问题,内部影像元器件的性能永远不可能和相机相比较。这是也为什么以 Pixel 为标杆,手机走出了计算摄影的道路,而 TWS 耳机后来也同样选择了计算音频。

正如手机上计算摄影的发展,事实上这几年 TWS 耳机的迭代和改进,除了依赖元器件上的「堆料」,核心就是越来越依赖计算音频技术,通过算法的改进和算力的提高,在真无线耳机的产品形态下实现接近甚至超越有线耳机的音频体验。

而在今天,恰恰就是计算音频技术大大推动了 TWS 耳机在降噪、音质以及空间音频体验的持续改进,包括智能动态降噪等功能。

2022 年底,OPPO 发布了第二颗自研芯片马里亚纳 Y,OPPO 芯片产品高级总监姜波在接受媒体采访时就表示,「蓝牙只是马里亚纳 Y 的一部分,这颗芯片实际要解决的问题是计算音频。」

不过在计算音频这个方向,近年来还有一种新的趋势慢慢的变明显,那就是 AI 驱动。很多音频领域的专业技术人员都指出,在不少算法中 AI 部分已经彻底取代了传统的算法。

需要指出的是,不仅是在音频领域,包括视频编解码器也都在转向基于 AI 驱动。这是因为今天传统编码框架下的压缩效率几乎已经到了极限,与此相对的是,「(AI 驱动的编解码器)用算力换掉了编码残差所需要的码率,显著突破了传统框架下的编码效率。」有行业人士在知乎上写道。

简而言之就是,不同于传统的编解码器,AI 驱动编解码器只需要相对少量的关键信息,就可以渲染出一个相对饱满的音频信号,实现更好的音质。这就像是通过超分(分辨率)技术,将低分辨率的图像通过 AI 渲染成高分辨率的图像。

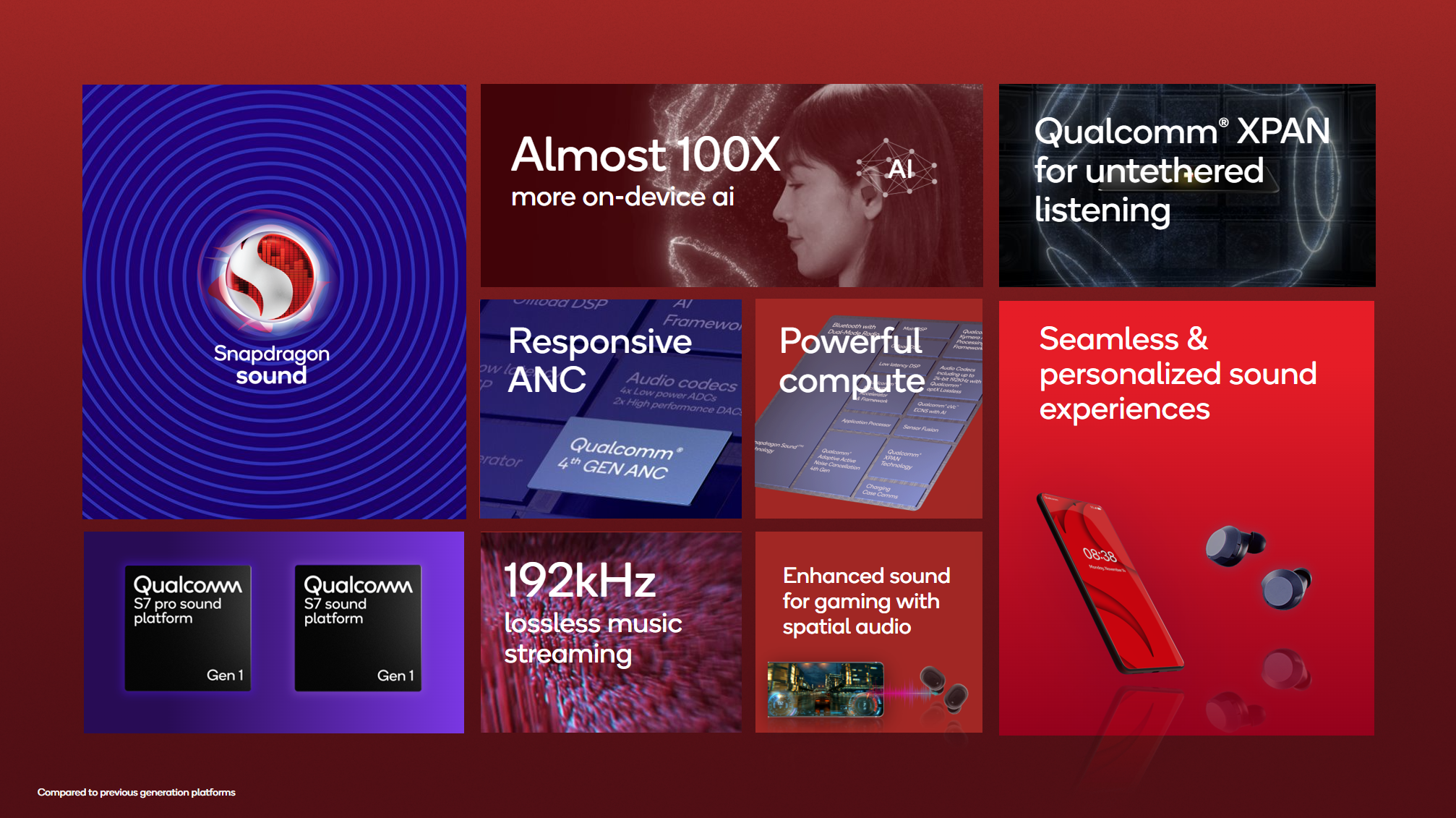

毫无疑问,AI 对于耳机而言正在慢慢的变重要,这可能也是怎么回事在去年 10 月的骁龙峰会上,高通推出了定位超高端的第一代高通 S7/S7 Pro 音频芯片,而且主打的宣传点就是:

「利用无与伦比的终端侧 AI 水平打造先进、个性化且快速响应的音频体验。」

首先是定位中端的第三代高通 S3,计算性能比前代芯片翻了一番。同时还支持高通语音和音乐合作伙伴扩展计划提供的各种第三方解决方案,包括了一系列提前验证过的技术,比如听力增强、空间音频、回声消除和健康追踪等功能,以此缩短 OEM 厂商推出新品的时间。

作为一款定位高端的音频芯片,第三代高通 S5 一大核心升级就是暴涨的端侧 AI 性能。根据高通介绍,第三代高通 S5 采用了高通 S7 的最新标准架构,计算性能相比前代提高了 3 倍,AI 性能更是达到了 50 倍以上。

而 AI 性能暴涨,带来最直接的优点是增强的 ANC 降噪和语音处理功能,除了更好的降噪体验,还能轻松实现响应更灵敏的「无缝音频体验」,即根据设备的使用方式和位置,在多设备间无缝切换和使用。同时,第三代高通 S5 还能实现超低功耗运行。

事实上,第三代高通 S5 在 AI 性能上的提升和重视并不意外。在去年秋天发布的第一代高通 S7 系列(同架构)上,高通就实现了近 100 倍的 AI 性能提升,还特意提到了端侧 AI 的协同工作能够在工作、游戏等任何场景下提供沉浸和个性化的音频体验。

高通没有详细的介绍过具体的流程,但推测大致应该是 AI 模型利用端侧 AI 的算力以及传感器和活动数据,识别用户的使用场景,再根据具体的场景进行智能计算和调整。

想象一下,在 AI 的协同工作下,耳机可以在我们处在家中休息自动提供最高音质的声音体验;在游戏时又能调整为最低延迟的声音反馈;在通勤路上智能调整降噪效果;在安静时调小音量,在喧闹时自动提高音量或者通话人声的清晰度。

这或许就是 TWS 耳机在音频体验上超越传统有线耳机的关键。今天,AI 模型在足够分辨率下,可完全通过训练和调校了解什么是好的图像和好的声音,并且有能力生成高质量的图像和声音,也有能力根据每个人的偏好和习惯提供更好的声音体验。

或许在计算音频的道路上,我们还会像曾经计算摄影面对的争论,面对声音的「真实与好」「还原与计算」等等争论。但能确定的是,相比传统音频缓慢的进步速度,AI 驱动的计算音频还有很大的潜力需要挖掘,就算高通不押注,更多有想法、敢突破的厂商也不会错过。